はじめに

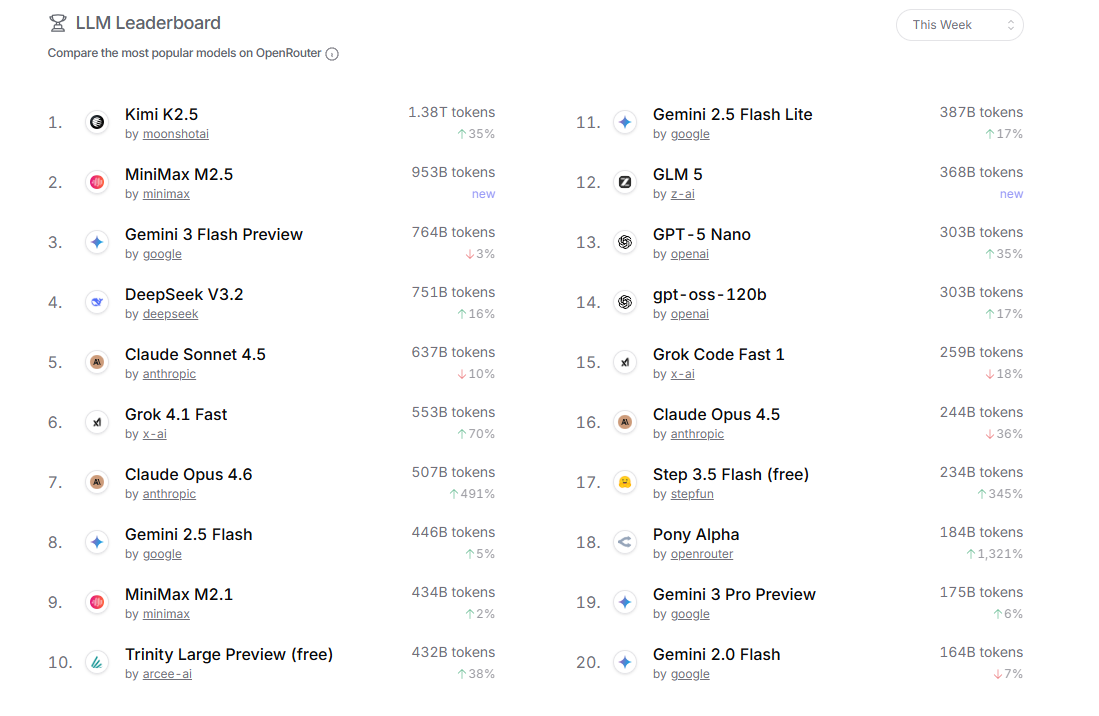

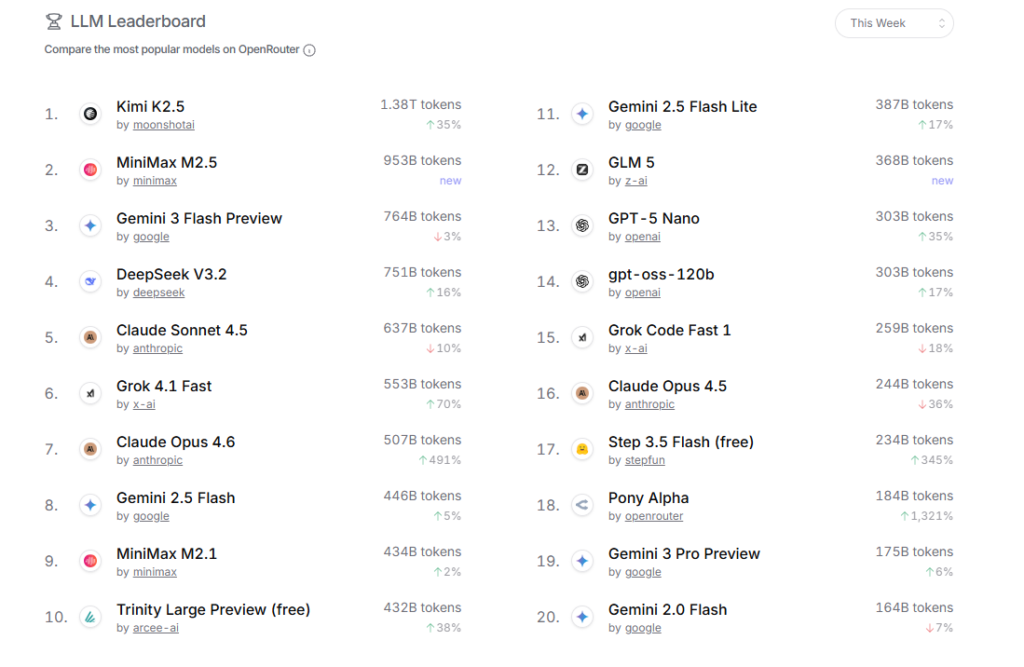

OpenRouterの最新ランキング(2026年2月時点)は、AI業界の勢力図が大きく変化していることを示しています。中国勢の台頭、エージェント機能への特化、そして長文コンテキストの実用化が、今週のトレンドを象徴しています。本記事では、トップ20にランクインしたモデルの特徴と実務における選定ポイントを詳しく解説します。

トップ10モデル詳細解説

1位:Kimi K2.5(Moonshot AI)- 1.38Tトークン、35%増

圧倒的な長文処理能力で首位を獲得

Moonshot AIが提供するKimi K2.5は、256k規模の長文コンテキストを前提とした設計が最大の特徴です。今週35%の利用増加を記録し、堂々の1位を獲得しました。

主な強み:

- 長文資料の一括処理に特化した設計思想

- 複数資料の突合・横断要約が得意

- エージェント的な段取り(計画→実行→検証)をサポート

適用シーン: 要件定義書、議事録、コード、仕様書など複数の文書を横断的に要約・分析する業務に最適です。例えば、プロジェクトの全ドキュメントを投入して整合性チェックや影響範囲分析を行うといった用途で真価を発揮します。

注意点: 長コンテキスト処理は推論コストが高く、ローカル運用時にはメモリや計算資源の確保が必要です。

2位:MiniMax M2.5 – 953Bトークン(新登場)

実務生産性を最優先したビジネス特化型モデル

MiniMaxが「real-world productivity(実務生産性)」を前面に押し出した新モデルです。前世代のM2.1(コード生成特化)の強みを継承しつつ、オフィス文書処理に大幅に対応しました。

主な特徴:

- Word/Excel/PowerPoint相当の文書生成・操作

- エージェント運用での高速処理

- ツール連携による複数ステップ作業の自動化

ユースケース: 「AIに事務作業の下ごしらえをさせたい」「ドキュメントや表計算のたたき台を量産したい」といったニーズに直接応えるモデルです。業務報告書の自動生成、データ分析レポートの作成、プレゼン資料の下書きなど、ホワイトカラー業務の効率化に貢献します。

3位:Gemini 3 Flash Preview(Google)- 764Bトークン、3%減

低レイテンシとマルチモーダルを両立

Gemini 3系のFlashラインは「低レイテンシ・高スループット」を重視した設計です。今週は3%減少しましたが、依然として強力なポジションを維持しています。

技術的特徴:

- 推論・制御・マルチモーダル忠実度の改善

- 複雑なエージェントワークフローに対応

- 高速応答が求められるアプリケーションに最適

商用利用の注意点: Preview表記のため、仕様・価格・上限が変わる可能性があります。商用要件(SLA、リージョン、監査)を置く場合は、正式提供条件を必ず確認してください。

4位:DeepSeek V3.2 – 751Bトークン、16%増

「思考」とツール利用を統合した次世代アーキテクチャ

DeepSeek V3.2の最大の革新は、「ツール利用の中に”thinking”を統合」した点です。16%の利用増加は、この設計思想が市場に評価されている証拠でしょう。

技術的革新:

- 疎な注意機構による長文効率の改善

- エージェント訓練データの独自合成手法

- ツールを呼ぶ前提での推論プロセス

適用領域: 外部ツール(検索、実行、RPA)と組み合わせる設計で真価を発揮します。ただし、思考モードとツール利用モードで挙動が変わるため、プロンプトと評価設計をセットで構築することが重要です。

5位:Claude Sonnet 4.5(Anthropic)- 637Bトークン、10%減

コーディングとエージェント構築の定番

Anthropicは、Sonnet 4.5を「コーディング」「複雑なエージェント構築」「コンピュータ操作」で強いモデルとして明確に位置づけています。

主要な強み:

- 最大1Mトークンのコンテキストウィンドウ

- Computer Use機能による自動操作

- 長時間タスクを丁寧に処理する設計

推奨シーン: 長文ドキュメントを読み込みながら実行を伴うタスク、複雑なコーディングプロジェクト、段階的な問題解決が必要な業務に最適です。

利用上の留意点: 組織の利用ティア等によって利用条件が異なる場合があります。

6位:Grok 4.1 Fast(xAI)- 553Bトークン、70%増

2Mコンテキストと高速ツールコーリングの組み合わせ

xAIのGrok 4.1 Fastは、今週70%という驚異的な伸びを記録しました。その背景には、強力なツール連携機能があります。

技術仕様:

- 2Mトークンの大規模コンテキスト

- Agent Tools API(Xデータ、Web検索、コード実行等)との統合

- サポート業務や金融分析での高速処理

アーキテクチャ: 「調べて・実行して・結果をまとめる」という一連の流れを効率的に処理できる設計です。

設計上の要点: ツール連携が前提のため、外部実行の権限設計(ログ管理、個人情報保護、ネットワーク制御)が重要になります。

7位:Claude Opus 4.6(Anthropic)- 507Bトークン、491%増

最新フラッグシップ、エージェント性能で圧倒

Opus 4.6は今週491%増という驚異的な成長を遂げました。Anthropicの最新フラッグシップとして、エージェント的ハーネス(サブエージェント・多数ツールコール)での性能を前面に出しています。

特化領域:

- サイバーセキュリティ調査

- 難度の高い推論と実行を長い手順で処理

- 複雑な多段階タスクの自動化

安全性への配慮: 強力なモデルほど悪用リスクも高まります。業務導入では、ガードレール(拒否方針、ツール制限、監査ログ)を初期段階から組み込むことが推奨されます。

8位:Gemini 2.5 Flash(Google)- 446Bトークン、5%増

価格性能バランスに優れた実用モデル

GoogleはGemini 2.5 Flashを「価格性能バランスが良い」と説明しており、Flashラインとして初めて”thinking capabilities”を備えた点が注目されます。

適用用途:

- 大量要約、分類、FAQ生成

- 軽量なエージェント処理

- 高頻度・低遅延が求められるアプリケーション

選定のポイント: Vertex AIやGemini APIのモデル一覧で用途が整理されているため、プロダクト要件(マルチモーダル、ツール、キャッシュ)に合わせて選びやすいモデルです。

9位:MiniMax M2.1 – 434Bトークン、2%増

コーディング特化の前世代モデル

M2.5の登場により「前世代」となったM2.1ですが、依然として一定の需要があります。

技術特性:

- MoE(Mixture of Experts)アーキテクチャ

- 総パラメータ規模は大きいが、推論時にアクティブなのは一部

- コード生成・リファクタに特化

位置づけ: M2.5への移行を検討する際の比較対象として、また「コーディング特化・高速」という要件に最適化されたモデルとして選ばれています。

10位:Trinity Large Preview(free)(Arcee AI)- 432Bトークン、38%増

大規模MoEのオープンソース系選択肢

Arcee AIが公開しているTrinity系の大規模MoEモデルで、Preview版はチャット用途に軽くポストトレーニングされています。

技術仕様:

- 約400B規模、アクティブは十数B

- 長文理解に対応

- 大規模な学習トークン

“free”表記の意味: プラットフォーム側の無料提供枠であることが多く、商用の継続運用では提供条件(無料枠上限、レート制限、ログ保持)を必ず確認する必要があります。

11位〜20位:注目モデルの概要

11位:Gemini 2.5 Flash Lite – 387Bトークン、17%増

低レイテンシ向けの「バランス型」として、2.5系の機能(thinking、ツール連携、マルチモーダル、1Mコンテキスト)を維持しつつ軽量運用を実現。大量処理でコストと遅延を最優先する場合(バッチ要約、抽出、タグ付け等)に最適です。

12位:GLM 5(Zhipu / Z.ai)- 368Bトークン(新登場)

中国Zhipu(智譜)の新フラッグシップ。コーディングと長時間エージェント能力を強化し、2026年初頭の中国勢モデル競争を象徴するアップデートです。実務導入では、提供形態(オープンソース/商用API/ホスティング)と利用地域・規約の確認が不可欠です。

13位:GPT-5 Nano(OpenAI)- 303Bトークン、35%増

OpenAIのGPT-5シリーズで「最速・最安」を掲げるモデル。要約・分類などの定型処理に適し、入力に画像も含められます。40万級のコンテキストを持ちますが、複雑な推論や長い計画実行が必要な場合は上位モデル(miniやフル)の利用が推奨されます。

14位:gpt-oss-120b(OpenAI)- 303Bトークン、17%増

OpenAIが”open-weight”として公開したgpt-ossシリーズ。Apache 2.0ライセンス下で、自前ホスティング(オンプレ/閉域)や機密データ処理に対応します。ただし、運用責任(安全設定、監査、更新、最適化)は利用側が負います。

15位:Grok Code Fast 1(xAI)- 259Bトークン、18%減

コーディング特化の高速モデル。大量の反復タスク(修正→テスト→デバッグのループ)向けで、高頻度のIDE/CI連携や軽量なエージェント的コーディングで「速さ・回転数」を重視する場合の選択肢です。

16位:Claude Opus 4.5(Anthropic)- 244Bトークン、36%減

Opus 4.6の直前世代として、実務系(スプレッドシート自動化、財務モデリング等)での改善を強調。安定性・コスト・性能のバランスで採用されるケースがあります。

17位:Step 3.5 Flash(free)(StepFun)- 234Bトークン、345%増

StepFunのオープンソース系モデルで、MoE(総196B級・アクティブ11B級)による効率的な推論を実現。エージェント用途と推論の深さ、リアルタイム性の両立を狙った設計です。オープン系の利点(自前運用、改変、コスト最適化)を活かしたい場合に候補となります。

18位:Pony Alpha(OpenRouter)- 184Bトークン、1,321%増

OpenRouterが提供するファウンデーションモデル。コーディング、エージェント的ワークフロー、推論、ロールプレイ等に対応します。

重要な注意点: プロンプトと生成結果がプロバイダにログされ、改善に利用される旨が明記されています。機密情報を扱う業務では、このログ方針が採用可否を左右します。

19位:Gemini 3 Pro Preview(Google)- 175Bトークン、6%増

Gemini APIの最上位「最も知的なモデル」として、マルチモーダル理解やエージェント的コーディングを強調。Preview版のため、料金やプロンプト長で価格が段階化される構造があります。重い推論・高難度タスク向けですが、Preview版からGA版への移行計画も同時に設計すべきです。

20位:Gemini 2.0 Flash(Google)- 164Bトークン、7%減

“agentic era”向けの新モデルとして、高速・ビルトインツール利用・マルチモーダル・1Mコンテキストを備えます。処理量が多いが推論深度はほどほどでよい案件で、コストと速度のバランスから選択されています。

市場トレンド分析

1. 中国勢の急速な台頭

Kimi K2.5(1位)、MiniMax M2.5(2位)、GLM 5(12位)と、トップ20のうち3モデルが中国企業によるものです。特に長文処理とビジネス実務への特化が際立っており、欧米モデルとは異なる設計思想を打ち出しています。

2. エージェント機能の主流化

ほぼすべてのトップモデルが「エージェント」「ツール連携」「多段階実行」を主要機能として掲げています。単純な質問応答から、計画→実行→検証という一連のワークフローを自律的に処理するAIへの転換が明確です。

3. 長文コンテキストの実用化

1Mトークン超のコンテキストウィンドウが標準化しつつあります。これにより、プロジェクト全体のドキュメントを一度に投入して分析するといった、これまで困難だったタスクが現実的になっています。

4. コスト対性能の最適化競争

「Flash」「Lite」「Nano」といった軽量版モデルの充実が目立ちます。用途に応じてモデルを使い分け、コストを最適化する時代に入っています。

モデル選定の実務ガイド

長文処理が必要な場合

推奨: Kimi K2.5、Claude Sonnet 4.5、Grok 4.1 Fast

複数の長文ドキュメントを横断的に分析する必要がある場合、256k〜2Mトークンのコンテキストを持つこれらのモデルが最適です。

オフィス文書作成・自動化

推奨: MiniMax M2.5、Claude Opus 4.5

Word/Excel/PowerPoint相当の文書生成や、スプレッドシート自動化に特化したモデルです。

コーディング支援

推奨: Claude Sonnet 4.5、MiniMax M2.1、Grok Code Fast 1

コード生成、リファクタ、デバッグ支援に強いモデル群。開発効率の向上に直結します。

大量処理・低コスト運用

推奨: Gemini 2.5 Flash Lite、GPT-5 Nano、Gemini 2.0 Flash

定型的な要約、分類、タグ付けなど、大量処理でコストを抑えたい場合に最適です。

複雑なエージェントタスク

推奨: Claude Opus 4.6、DeepSeek V3.2、Gemini 3 Pro Preview

サイバーセキュリティ調査、複雑な問題解決など、高度な推論と実行を組み合わせたタスクに対応します。

オープンソース・自前運用

推奨: gpt-oss-120b、Step 3.5 Flash、Trinity Large Preview

機密データや閉域ネットワークでの運用が必要な場合、オープンウェイトモデルが選択肢となります。

商用利用時の注意事項

Previewモデルの扱い

Gemini 3 Flash Preview、Gemini 3 Pro Preview、Trinity Large Previewなど、「Preview」表記のモデルは仕様・価格・上限が変わる可能性があります。商用導入では:

- 正式提供(GA)への移行計画を確認

- SLA、リージョン、監査要件の確認

- Preview期間中の価格変動リスクの評価

ログとデータ保持ポリシー

特にPony Alphaのように、プロンプトと生成結果がプロバイダにログされるモデルもあります。機密情報を扱う業務では、各モデルのデータ保持ポリシーを必ず確認してください。

ライセンスと運用責任

オープンウェイトモデル(gpt-oss-120bなど)は、Apache 2.0などのライセンス下で自由に利用できますが、安全設定、監査、更新、最適化などの運用責任は利用側が負います。

コンテキスト長と料金体系

多くのモデルで、プロンプト長に応じて料金が段階化されています。長文処理を前提とする場合、コスト試算を事前に行うことが重要です。

まとめ

2026年2月のLLMランキングは、AI業界の成熟と多様化を如実に示しています。中国勢の台頭、エージェント機能の主流化、長文コンテキストの実用化という3つの大きなトレンドが同時進行しており、選択肢は豊富になっています。

重要なのは、「最も人気のあるモデル」ではなく、「自社の業務要件に最も適したモデル」を選ぶことです。本記事で紹介した各モデルの特性と選定ガイドを参考に、最適なAI活用を実現してください。

また、AI技術は日々進化しています。Preview版の正式リリース、新モデルの登場、価格体系の変更など、最新情報を常にキャッチアップすることをお勧めします。